首次提出:一种用于解决点云场景中同类对象分割的端到端网络

融合协同对比学习和相互注意采样机制进行无监督点云对象的同类分割

Unsupervised Point Cloud Object Co-segmentation by Co-contrastive Learning and Mutual Attention Sampling

代码地址:https://github.com/jimmy15923/unsup_point_coseg

在本文中作者提出了一项新的点云问题,点云同类对象分割,即分割一组场景点云中的同类3D 对象(可以看作是一个二类(前景、背景)分割问题)。作者将此任务定义为一个对象点采样问题,并通过相互注意模块和共同对比学习机制实现它。所提出的方法采用基于神经网络的两点采样器,即对象采样器和背景采样器。其中前者针对常见物体的采样,而后者则专注于其他物体。相互注意模块探索点云之间的逐点相关性。它嵌入在两个采样器中,可以从其他采样器中识别出具有强行跨越云相关性的点。在为两个采样器选择的点提取特征后,继续通过开发协同对比损失函数来优化网络,这样可以最小化估计对象点之间的特征差异,同时最大差异化估计对象和背景点之间的特征。该方法适用于任意对象类的点云。它是端到端可训练的,不需要点级注释。通过在 ScanObjectNN 和 S3DIS 数据集上进行评估,并取得了有潜力的结果。本文主要贡献如下:

1)首次尝试为点云同类对象分割开发端到端的可训练网络。

2)其次,将点云同类对象分割定义为采样任务,由提出的相互注意模块和共同对比学习机制来完成最终采样。

3)第三,作者的方法在两个真实数据集上进行了评估,并展示网络的潜力。

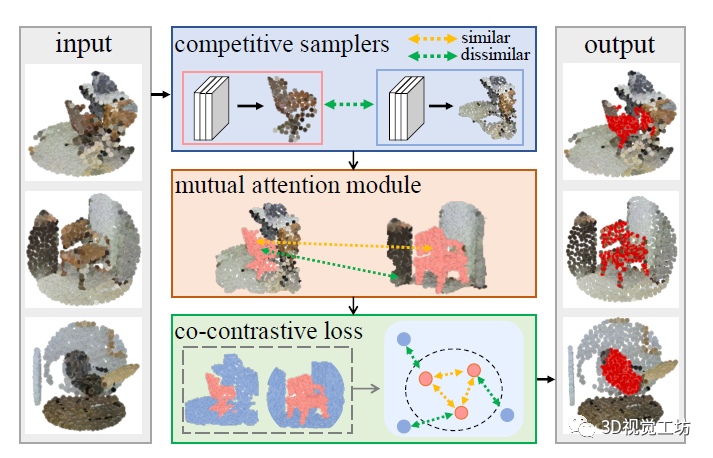

图1 无监督点云同类对象分割方法概述。该方法的输入是一组覆盖公共类别对象的点云(如本例中的椅子)。同时该方法只需要 3D 坐标作为输入。

1、目前存在的问题

基于深度学习的点云分割方法大量依赖于带有点级注释的训练数据。训练数据收集的高注释成本阻碍了点云分割的效率。

在2D 图像同类对象分割问题中,可以在没有附加注释的情况下分割一组图像中的常见对象。极大的降低了标注成本。然而,如果直接将 2D 图像同类对象分割技术应用于3D点云是具有挑战性的,因为它必须解决三个主要问题。

第一,大多数图像分割方法依赖于目标提议生成器或显着性检测器。这些生成器和检测器适用于图像像素,但不适用于 3D 点的空间几何。

第二,与图像相比,点云是无序和非结构化的。提取的点特征通常不足以进行同类对象分割。

第三,大多数 2D 同类对象分割方法采用预先在大型数据集上进行预训练的方式,例如 用ImageNet提取高级语义特征。

如图 1 所示,该方法主要包括三个模块,分别用于解决上述三个问题。

首先,作者将点云同类对象分割作为一个对象点采样问题处理。采用了一对点采样器:对象采样器针对属于常见对象的采样点,而背景采样器则抓取其余的采样点。其中,对象和背景采样器都是在SampleNet网络上开发。

其次,作者开发了一个相互注意模块来探索不同点云之间的逐点相关性,并嵌入到两个采样器中使用。识别给定图像或点云中的常见 2D 像素或 3D 点是同类对象分割的关键部分。为此,该模块计算跨点云的注意力图并编译用于共同分割的信息特征。实验证明,此模块的采样器可实现更好的前景-背景分离。

第三,开发了一种对比损失函数来解决缺乏预训练数据和缺乏用于共同分割的监督信号的问题。通过最小化对象采样器采样的点的特征差异,同时最大化不同采样器选择的点之间的特征差异。作者使用这种损失函数来推导出采样器及其相关的相互注意模块。

2、核心方法

图2方法概述。网络架构由两个相互注意模块的采样器 So 和 Sb 以及一个特征提取器 f 组成。

1)问题描述:

针对一组覆盖未知类别对象的N个点云D。假设每个云中的点数为 M,点云同类对象分割就是要发现包含属于每个公共对象的所有点的子集。请注意,这里既没有提供点级注释,也没有提供点云级注释。并且只使用几何特征(没有任何 RGB 信息)。图 2是所提出方法的框架。

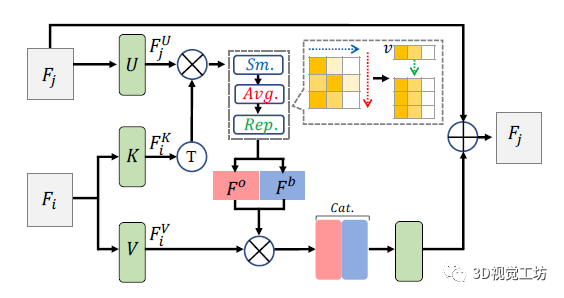

图 3 中给出了关于相互注意模块如何嵌入到采样器 So 和 Sb 中的详细过程。它的作用是估计跨点云、逐点的相互相关性,然后在采样期间将其考虑在内。

图3相互注意模块的架构

2)物体与背景采样:

这里作者将点云对象分割定义为前景点采样问题。基于最近的研究提出了点云采样的可微松弛。于是作者在 SampleNet 上开发了对象采样器 So 和背景采样器 Sb。具体来说,为了在点云上实现共同分割,作者对 SampleNet 进行了三项修改,包括下游任务、成对竞争采样器和跨点云注意机制。

其中下游任务是无监督的同类对象分割。由于缺乏数据注释,作者开发了无监督的协同对比损失,用来优化采样器。模型中的特征提取器 f 来为每个采样点生成特征。

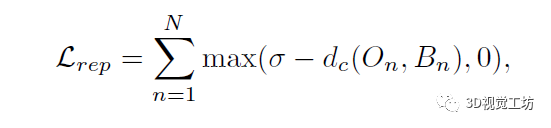

对于共同分割,目标就是将前景点与其他点分开。为此,作者使用对象采样器 So 和背景采样器 Sb分别为每个点云 P推断前景子集On和背景子集Bn。通过使用对比损失函数,采样器 So 和 Sb 分别倾向于收集前景和背景点。为了进一步防止两个采样器选择相同的点,作者还将排斥损失函整合到采样器训练中,即

其中dc是Chamfer距离,超参数σ=1控制分离余量。

3)相互注意模型:

受现有方法可以在非本地操作下完成捕获远程依赖项的自注意力模块的启发,作者开发了一个相互注意模块来发现跨点云点的相关性。与探索图像内位置相关性的自注意力模块相比,图3中所示的相互注意力模块侧重于小量级中点云之间的相互点相关性。如图 3 所示,作者还引入了残差学习以获得更好的性能。

4)共同对比损失:

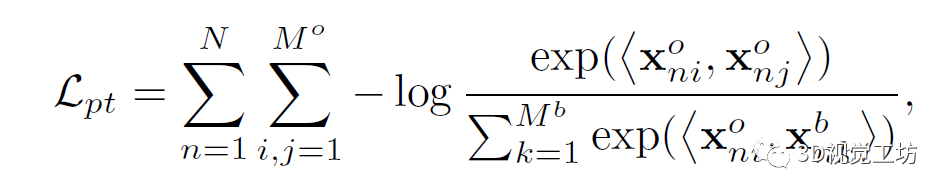

对比性学习近年来已经被研究用于无监督的表征学习。因此为了实现了在点云内部和点云之间的对比学习,作者分别在点和对象两个层面上实现。对比学习的训练数据通过增强的方式从一个数据实例中生成。

其中点对比损失函数为:

其中成对相似度是通过使用内积来衡量,N 是给定点云的数量

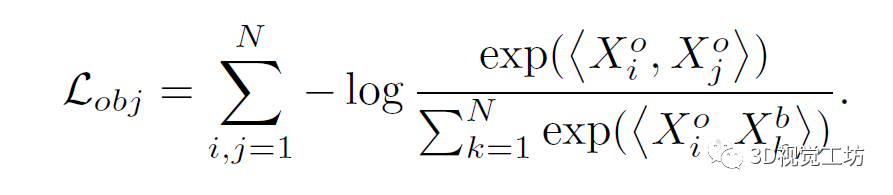

目标对比损失函数为:

在对象层面,一个数据对是由不同的点云创建的。此外,该部分还被用于共同分割,因此,作者将由此产生的目标函数命名为对比损失。

实验环节:

数据集:

由于点云对象共分割是一项新任务,因此还没有可用于评估的基准数据集。作者暂时采用的ScanObjectNN 和 S3DIS。

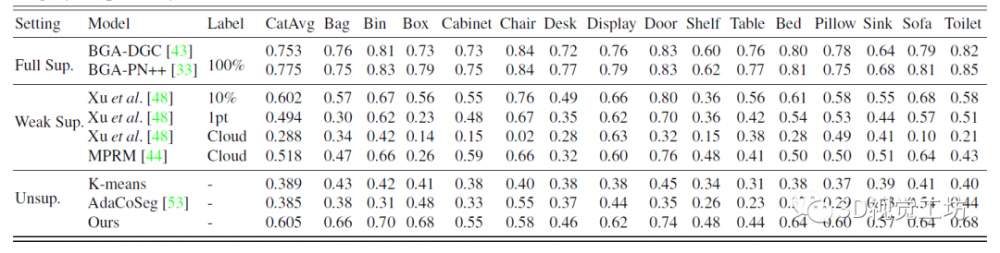

表1在具有不同监督级别和设置的不同方法在 ScanObjectNN 的 OBJ BG 测试集上的分割结果 (mIoU)。100%、10% 和 1pt 分别表示用 100%、10% 和每个对象类别的单个标记点训练的方法。

考虑到本文是第一个用于点云同类对象分割的方法,暂时没有同类的方法进行性能对比。实验环节采用与三种不同监督设置的点云对象分割方法进行比较。具体来说,首先,比较了点云分割的全监督方法,并将它们作为性能上限的参考。其次,比较了两种最新的弱监督分割方法。他们的目标是使用部分点级标签(point-level labels)或云级标签(cloud-level labels)作为弱注释形式来分割 3D 对象。第三,比较了最新的形状共同分割方法 AdaCoSeg。

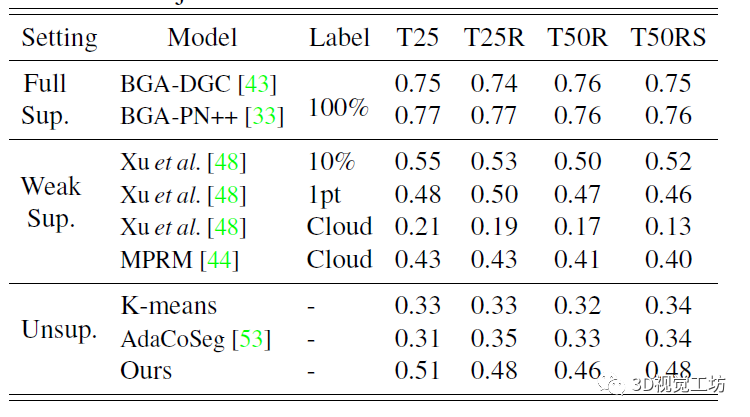

表2 ScanObjectNN 数据集上不同变体的分割结果 (mIoU)。

表3 S3DIS 数据集上的分割结果 (mIoU)

表4 ScanObjectNN 数据集的定性结果。从左到右,从上到下,分别是包、床、垃圾桶、椅子、门、枕头、架子、水槽、沙发和桌子。对于每个示例,作者展示了输入云、真实标签和分割结果。

表5 S3DIS 数据集的定性结果。作者展示了五个对象类的示例:从上到下分别为书柜、椅子、门、沙发和桌子,每个类有两个示例。对于每个例子,展示了输入点云、真实标签和分割结果

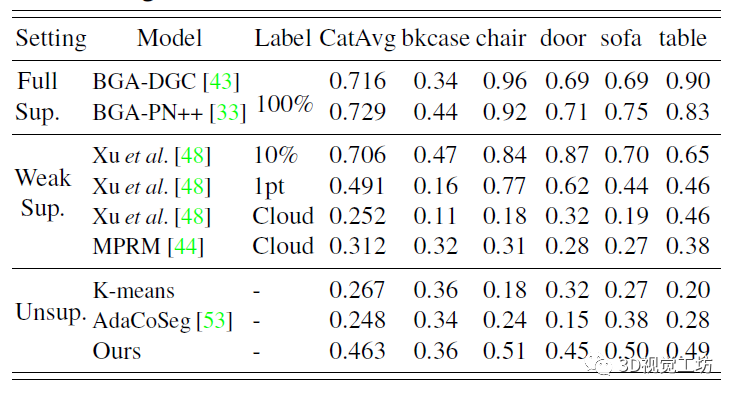

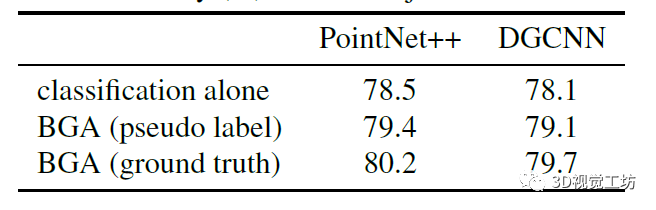

作者除了评估分割方法本身的效果之外,还对分割结果嵌入到背景感知网络background-aware network (BGA)进行分类效果的评价。表 5 显示使用伪标签进行训练可以提高分类准确率。

表 5:ScanObjectNN PB_T50_RS数据上的准确度(%)

总结:

本文提出了一个点云新问题,即点云同类对象分割问题,并提出了一种无需使用昂贵注释成本即可解决该问题的方法。此外,作者还证明了该方法可以提供伪标签以改善现实世界数据集中的对象分类性能。

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。