FastFCN:重新思考语义分割主干中的扩张卷积

论文:FastFCN: Rethinking Dilated Convolution in the Backbone for Semantic Segmentation (2019)

代码:https://github.com/wuhuikai/FastFCN

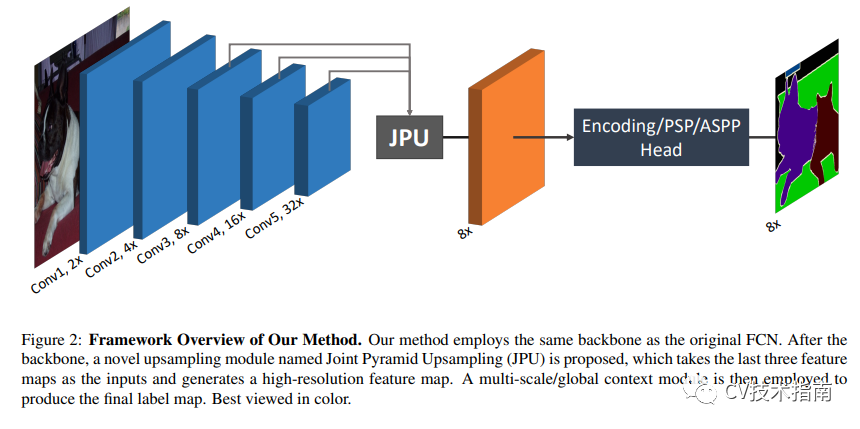

本文提出了一个名为Joint Pyramid Upsampling(JPU)的联合上采样模块来代替消耗大量时间和内存的扩张卷积。它的工作原理是将提取高分辨率地图的功能制定为联合上采样问题。

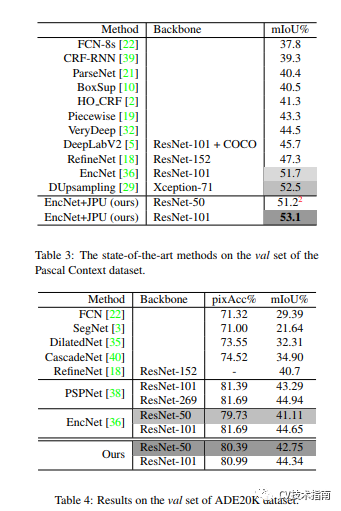

该方法在 Pascal Context 数据集上实现了 53.13% 的 mIoU 性能,并且运行速度提高了 3 倍。

该方法实现了一个全连接网络(FCN)作为主干,同时应用 JPU 对低分辨率的最终特征图进行上采样,从而产生高分辨率的特征图。用 JPU 替换扩张卷积不会导致任何性能损失。

联合采样使用低分辨率目标图像和高分辨率引导图像。然后通过传输引导图像的结构和细节来生成高分辨率的目标图像。

通过视频传播和标签松弛改进语义分割

论文:FastFCN: Rethinking Dilated Convolution in the Backbone for Semantic Segmentation (2019)

代码:https://github.com/NVIDIA/semantic-segmentation

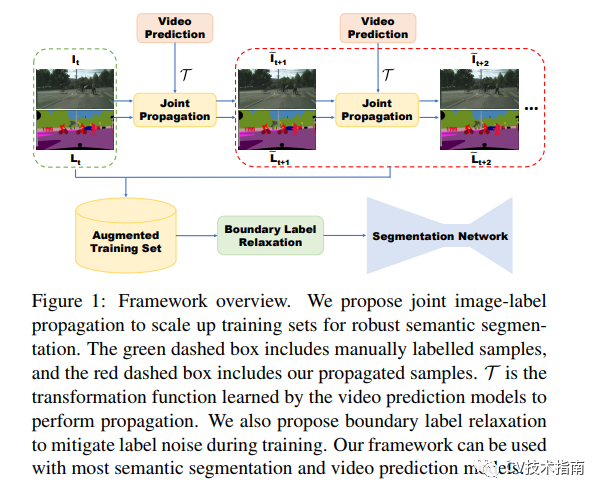

本文提出了一种基于视频的方法,通过合成新的训练样本来扩展训练集。这旨在提高语义分割网络的准确性。它探索了视频预测模型预测未来帧以预测未来标签的能力。

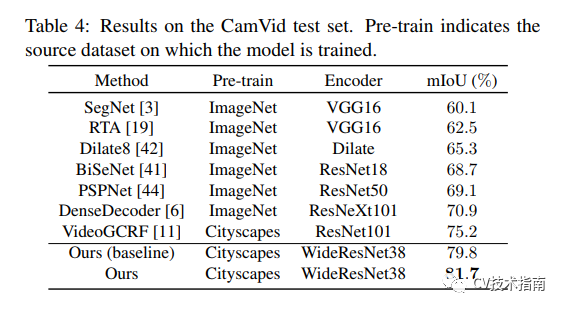

该论文表明,在来自合成数据的数据集上训练分割网络可以提高预测精度。本文提出的方法在 Cityscapes 上实现了 83.5% 的 mIoU,在 CamVid 上实现了 82.9%。

论文提出了两种预测未来标签的方法:

标签传播 (Label Propagation, LP) 通过将传播的标签与原始未来帧配对来创建新的训练样本

联合图像标签传播 (Joint image-label Propagation, JP) 通过将传播标签与相应的传播图像配对来创建新的训练样本

该论文有三个主要命题;利用视频预测模型将标签传播到直接相邻帧,引入联合图像标签传播来处理未对齐问题,并通过最大化沿边界的类概率并集的可能性来放松单热标签训练。

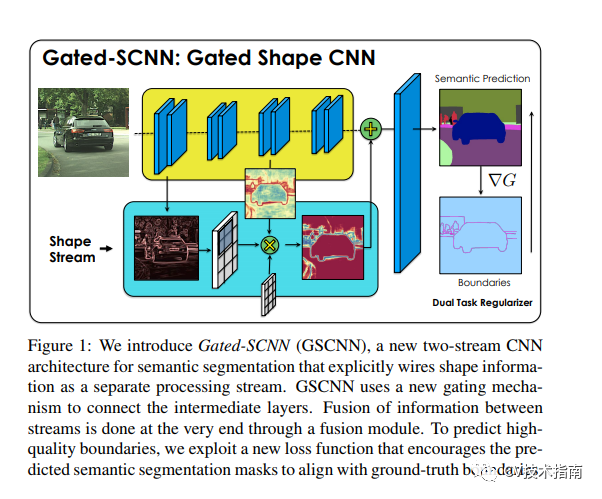

Gated-SCNN:用于语义分割的门控形状 CNN

论文:Gated-SCNN: Gated Shape CNNs for Semantic Segmentation (2019)

代码:https://nv-tlabs.github.io/GSCNN/

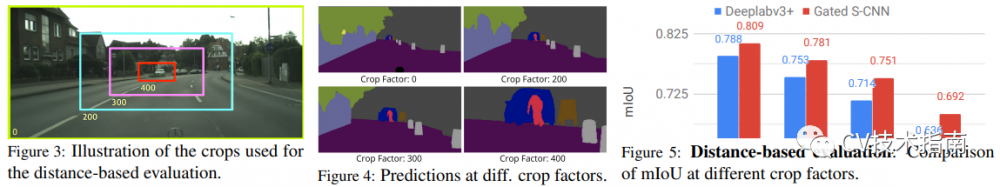

这篇论文是语义分割块上的最新成果。作者提出了一种双流 CNN 架构。在此架构中,形状信息作为单独的分支进行处理。此形状流仅处理与边界相关的信息。这是由模型的门控卷积层 (GCL) 和本地监督强制执行的。

该模型在 mIoU 上比 DeepLab-v3+ 高 1.5%,在 F 边界得分上高出 4%。该模型已使用 Cityscapes 基准进行评估。在更小更薄的物体上,该模型在 IoU 上实现了 7% 的改进。

下表显示了 Gated-SCNN 与其他模型相比的性能。

结论

我们现在应该掌握一些最常见的——以及一些最近的——技术,用于在各种上下文中执行语义分割。

在公众号后台回复关键字 “0009” 即可获取以上论文

原文链接:

https://heartbeat.comet.ml/a-2019-guide-to-semantic-segmentation-ca8242f5a7fc

本文仅做学术分享,如有侵权,请联系删文。

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。