最近,谷歌X的实习生Bowen Wen新开源了用于6D物体姿态跟踪的代码BundleTrack,该工作已经被今年的IEEE/RSJ International Conference on Intelligent Robots and Systems(IROS)录用。其中Bowen Wen为该论文唯一学生作者,此前也是se(3)-TrackNet的第一作者(目前state of art的基于CAD模型的6D姿态跟踪算法),目前为美国Rutgers大学的在读博士,过去几年曾在Facebook Reality Labs, 亚马逊和商汤科技实习。

以下是新开源代码相关的论文、视频、代码、作者个人主页等信息

论文名称:BundleTrack: 6D Pose Tracking for Novel Objects without Instance orCategory-Level 3D Models

论文下载:

https://arxiv.org/pdf/2108.00516.pdf

代码链接:

https://github.com/wenbowen123/BundleTrack

作者Github主页:

https://github.com/wenbowen123

贡献

该开源项目主要贡献如下

1. 一个全新的6D物体姿态算法,不需要实例或类级别的CAD模型用于训练或测试阶段。该算法可立即用于新颖物体的6D姿态跟踪

2. 在NOCS数据集上的创下全新记录,将以往的表现从33.3%大幅度提升到87.4%。在YCBInEOAT数据集上也达到了跟目前基于CAD模型的领先方法se(3)-TrackNet相近的表现。特别值得注意的是,与以往state of art的6D物体姿态跟踪方法相比,BundleTrack并不需要类级别的物体进行训练,也不需要测试阶段物体的CAD模型作模板匹配,减少了很多假设。

3. 首次将具有记忆功能的位姿图优化引入6D物体姿态跟踪。除了相邻帧的匹配还能够借助带记忆功能的历史帧解决特征匹配不足和跟踪漂移问题。

4. 高效的CUDA编码,使得本来计算量庞大的位姿优化图能在线实时运行,达到10Hz。足够用于AR/VR,视觉反馈控制操纵,物体级SLAM或动态场景下的 SLAM等。

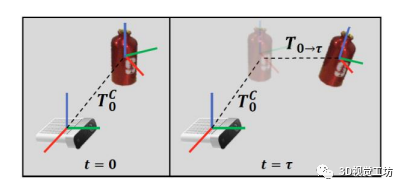

问题设置

对于需要6D跟踪的物体,该方法不需要任何类级别的CAD模型或者当前物体的CAD模型。所需要的输入只有(1)RGBD视频;(2)初始掩码,用于指定需要跟踪的物体。该掩码可以通过多种途径获得,例如语义分割,3D点云分割聚类,平面移除等等。该方法就能输出跟踪物体在相机前相对初始的6D姿态变换。

方法

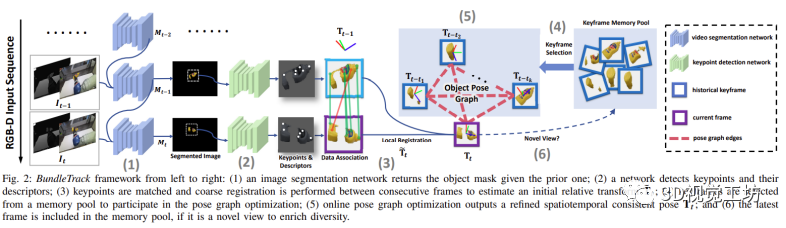

1)总览

本文所提出的 BundleTrack 框架的概述如图. 当前观察到的 RGB-D 帧

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。