5 “Heatmap-based Vanishing Point boosts Lane Detection“,arXiv 2007.15602,7,2020

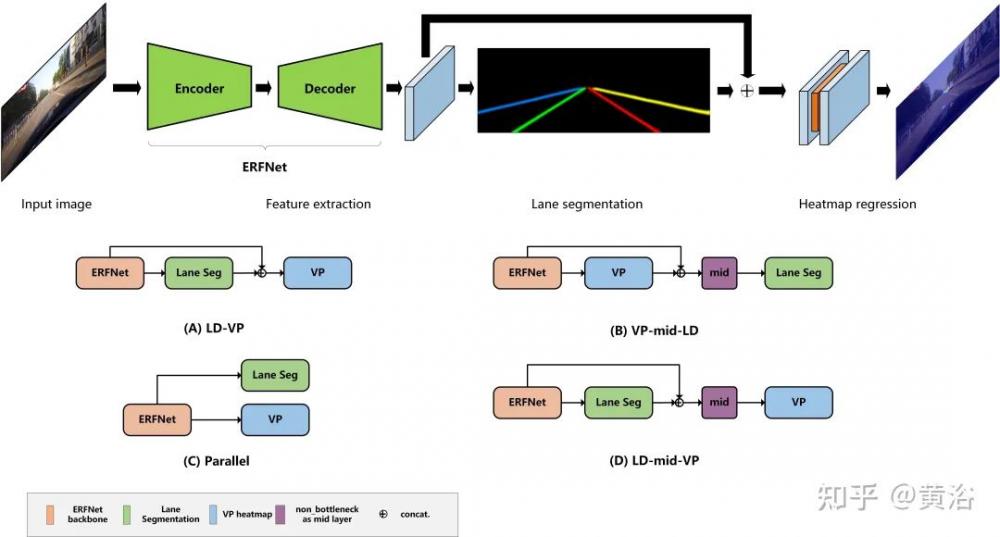

利用几何结构信息,vanishing point,提出一个多任务融合框架,基于ERFNet,图像分割模型,heatmap regression预测车道线的消失点VP。其示意图如下所示:

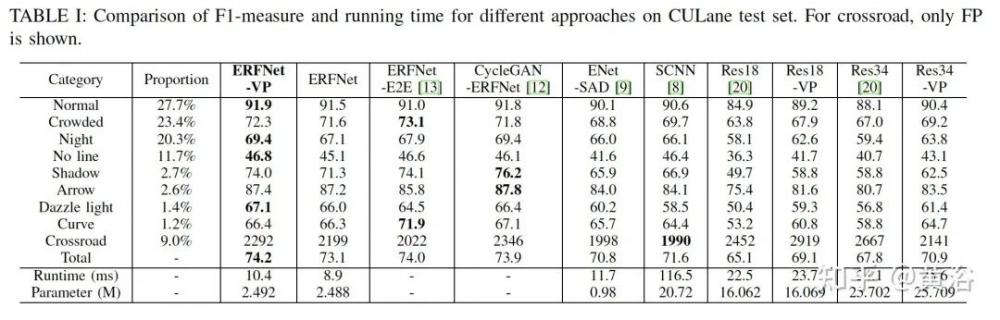

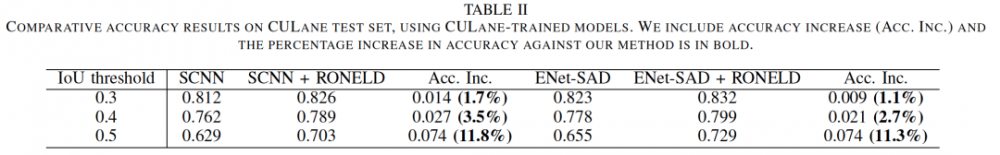

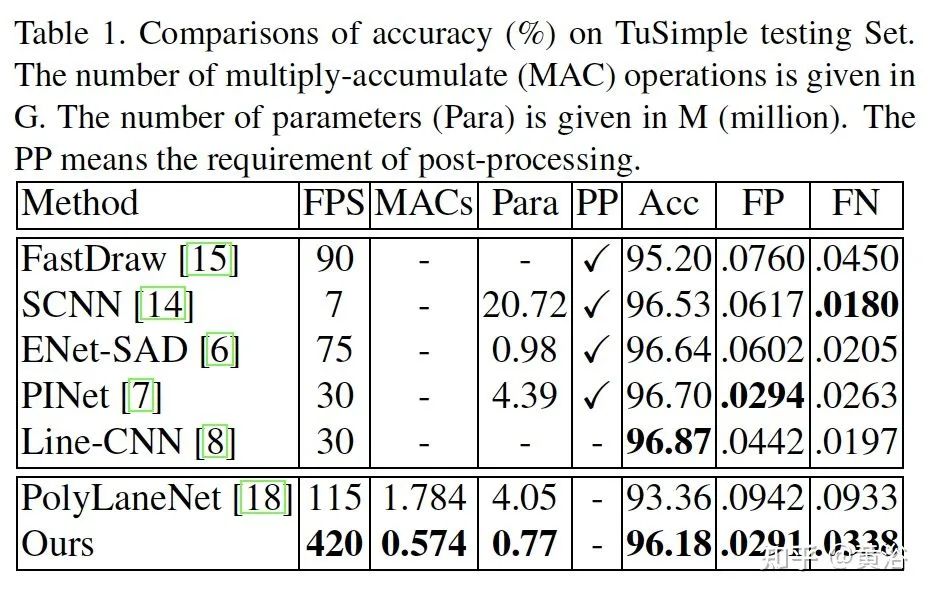

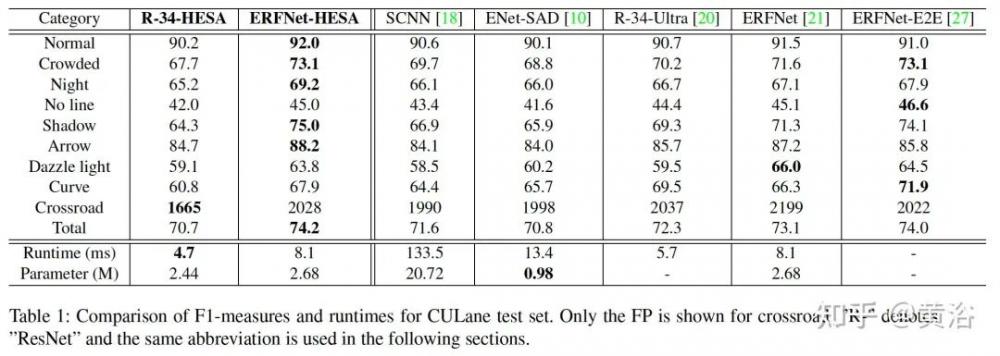

实验结果比较如下:

6 “LDNet: End-to-End Lane Detection Approach using a Dynamic Vision Sensor”,arXiv 2009.08020,9, 2020

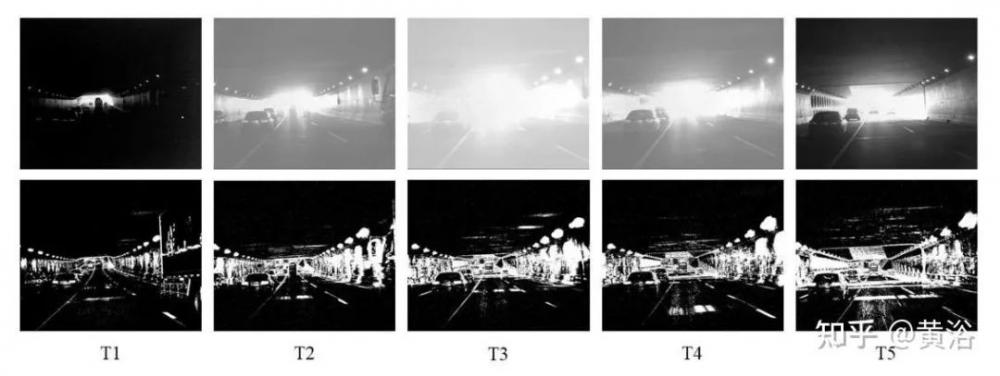

车道线检测的挑战:光照变化、太阳强光、运动模糊等等。这里采用事件摄像头(event camera)的动态视觉传感器,提出Lane Detection using dynamic vision sensor (LDNet)。

如图看普通摄像头和事件摄像头的区别:

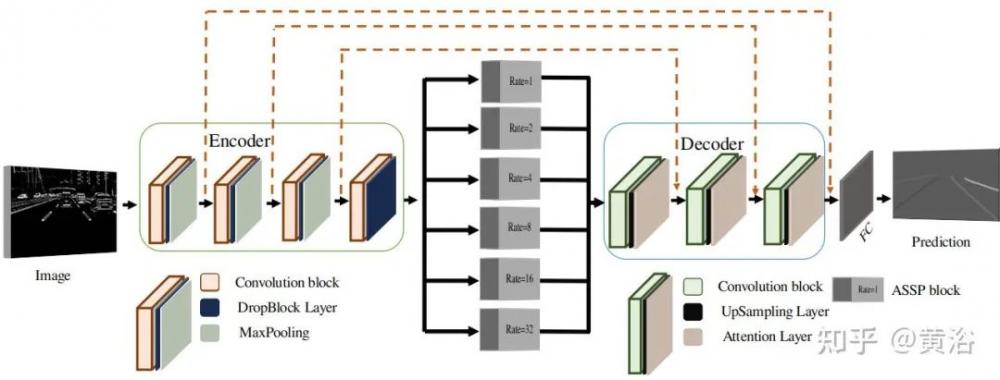

下图是LDNet的架构:

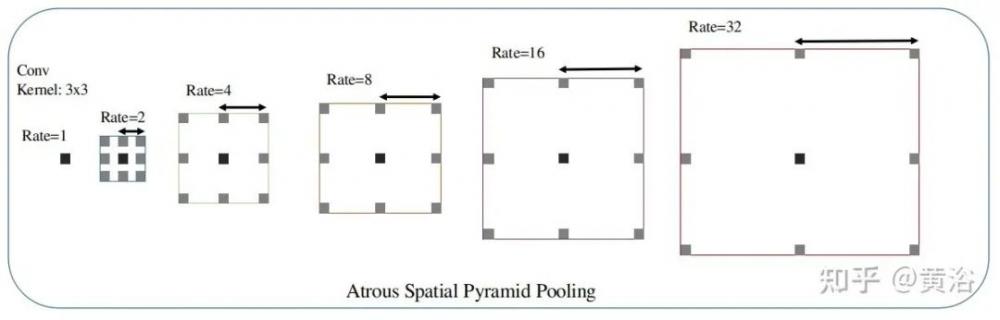

其中采用的空洞SPP:

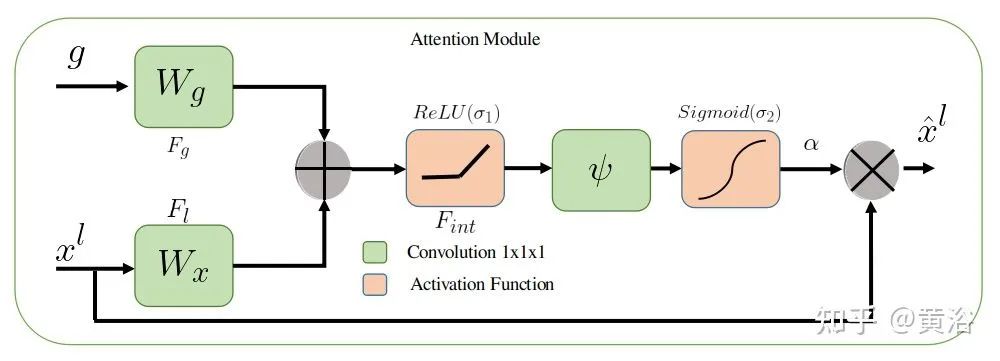

还有attention模块结构:

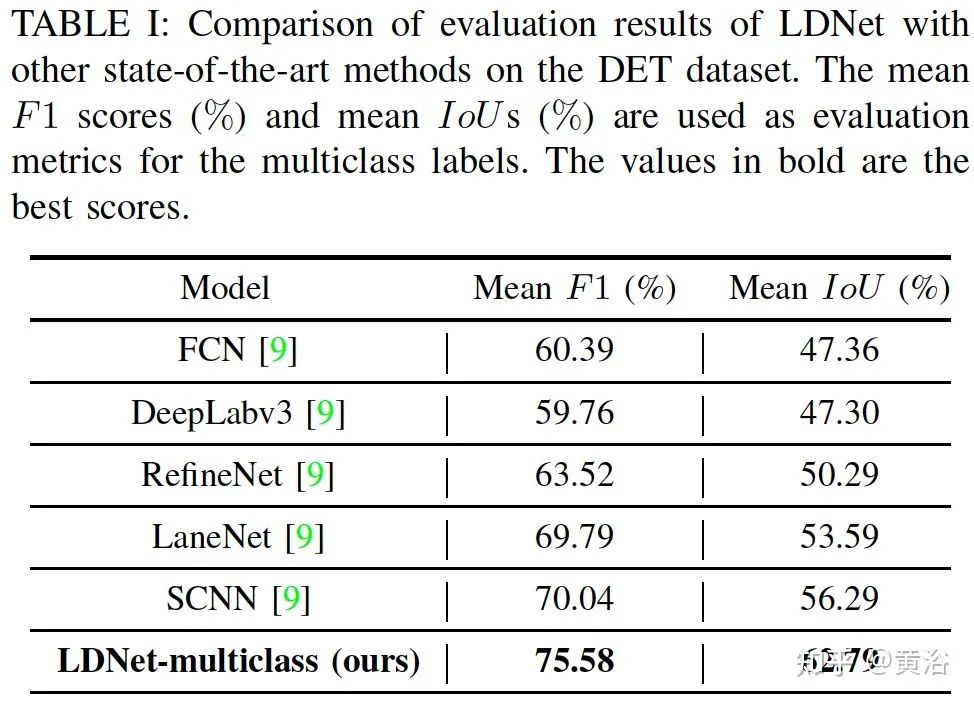

下表给出实验结果比较:

7 “RONELD: Robust Neural Network Output Enhancement for Active Lane Detection“,arXiv 2010.09548, 11, 2020

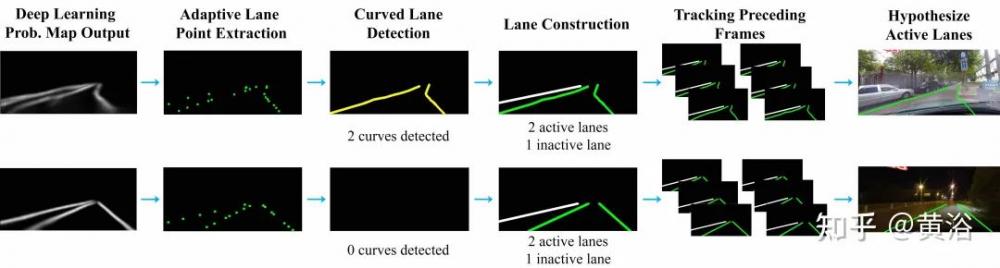

主动车道(active lane)划定单个道路的空间。检测的挑战来自外界的光照和车道自身单调表观。本文提出的方法实际上是一种增强方法,即real-time robust neural network output enhancement for active lane detection (RONELD)。其利用深度学习模型得到的概率图,包括以下模块:自适应车道点检测、弯曲车道检测、车道重建和跟踪等,如图所示。

注:这里采用了两个模型SCNN和ENet-SAD做实验。

这里是一些增强结果的比较:两个数据集测试

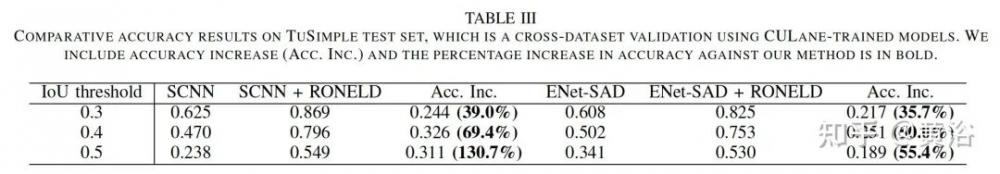

8 “Keep your Eyes on the Lane: Real-time Attention-guided Lane Detection“,arXiv 2010.12035,11,2020

LaneATT,和Line-CNN一样的,基于锚点的车道线检测方法,类似YOLO3和SSD。除了局部信息,也强调全局信息,比如遮挡、缺失或者弱显示等情况下的处理。该方法实时性强 (速度250FPS),在三个基准数据集测试过:TuSimple, CULane 和 LLAMAS。

其架构如图:除了锚点的特征池化(类似Fast R-CNN),还有attention机制的采用。

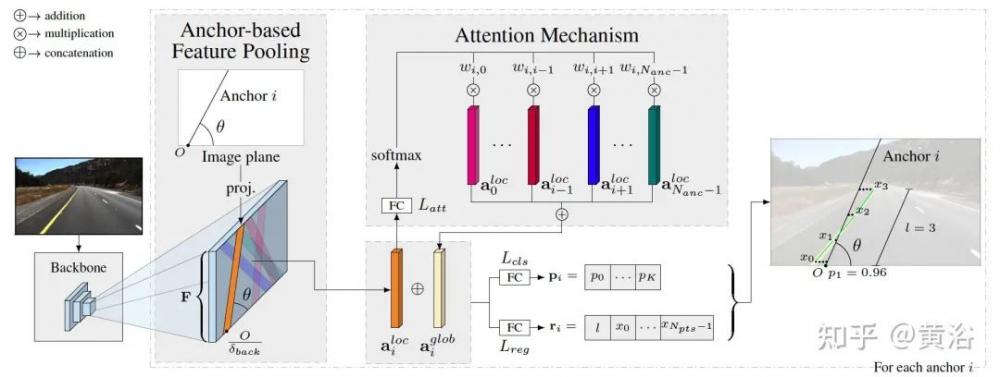

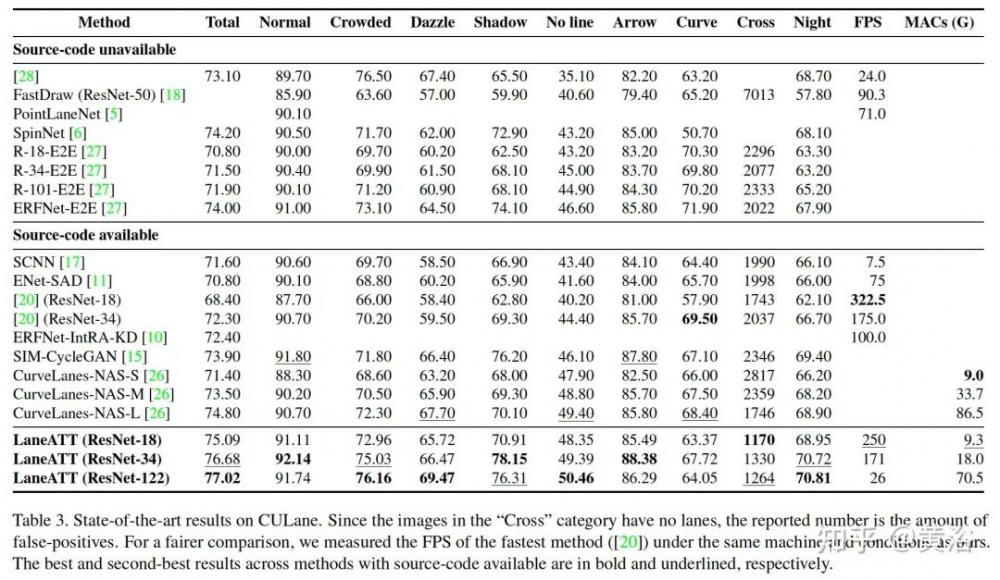

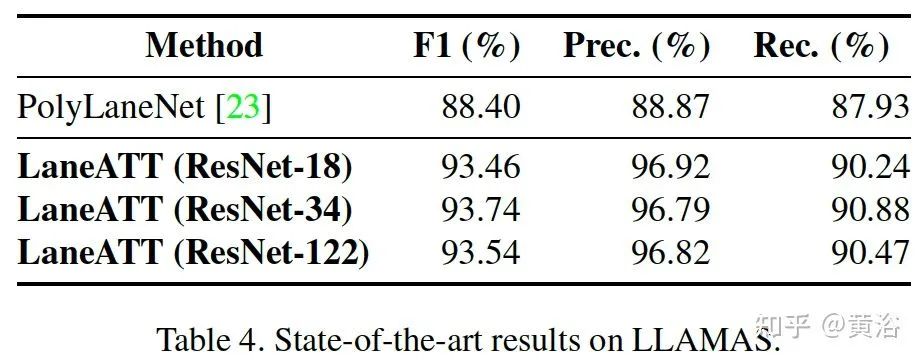

如下是结果比较:

9 “End-to-end Lane Shape Prediction with Transformers“,arXiv 2011.04233, 11,2020

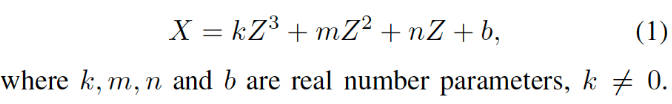

无所不在的Transformers,很善于学习全局上下文,针对车道线这种细长结构,直接估计车道线形状模型,即lane shape model。

代码上线:https://github.com/liuruijin17/LSTR

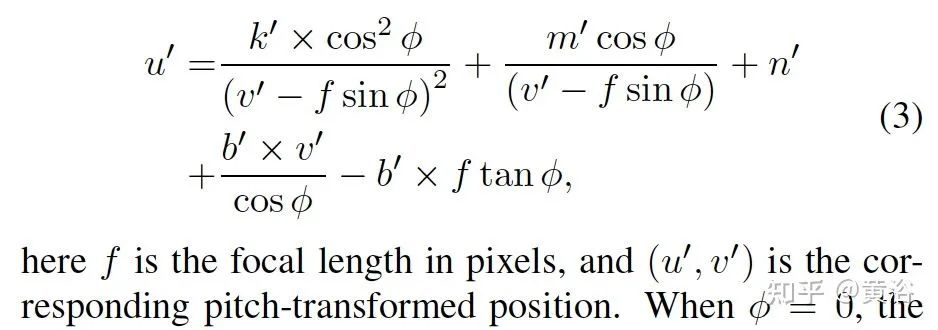

那么曲线投影到图像平面变成:光轴和路面平行

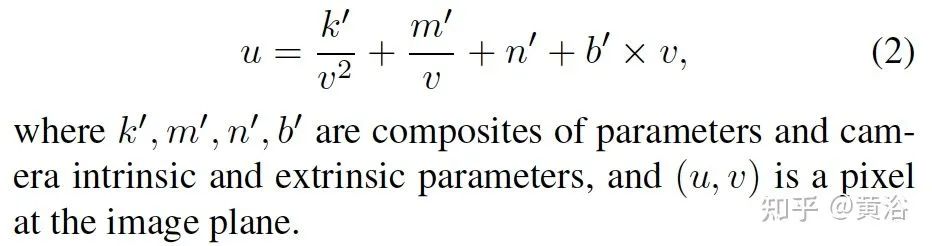

如果摄像头斜着,不与路面平行,则:

修正的曲线方程变成:

Hungarian fitting loss 在预测参数和真值车道线做bipartite matching,找到positives和negatives,很有效。

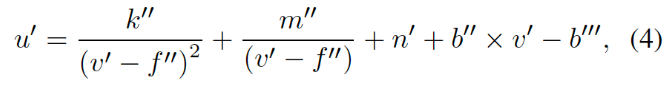

如图所示是主干架构:包括一个reduced transformer network, 几个feed-forward networks (FFNs) 做parameter predictions, 和Hungarian bipartite matching Loss。

给定输入图像I, 主干提取low-resolution feature,并扁平成 序列S;S和positional embedding Ep 输入编码器,输出表示序列Se;然后****产生输出序列Sd,其中输入查询序列 Sq 和一个学习的positional embedding ELL,然后计算其与Se、Ep的交互,得到特征;最后多个FFNs 直接预测输出参数。

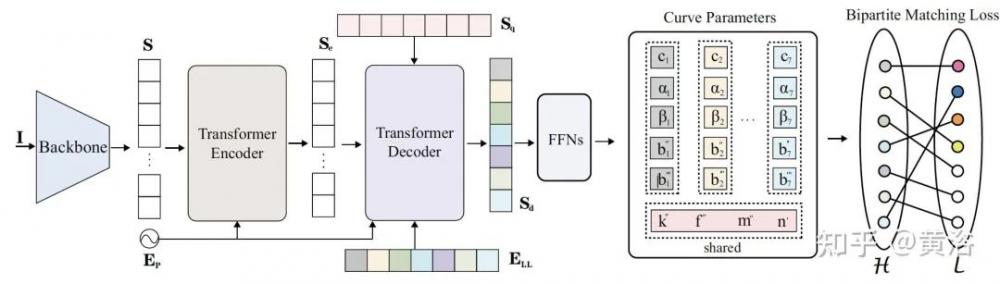

如图是编码器和****结构:

实验结果比较如下表:

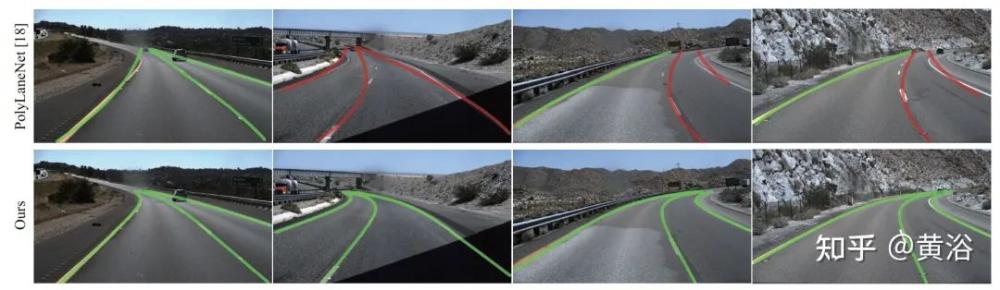

下图是TuSimple数据集的比较:

下面是在FVL数据集的transfer结果:没有额外训练

10 “End-to-End Deep Learning of Lane Detection and Path Prediction for Real-Time Autonomous Driving”,arXiv 2102.04738,2,2021

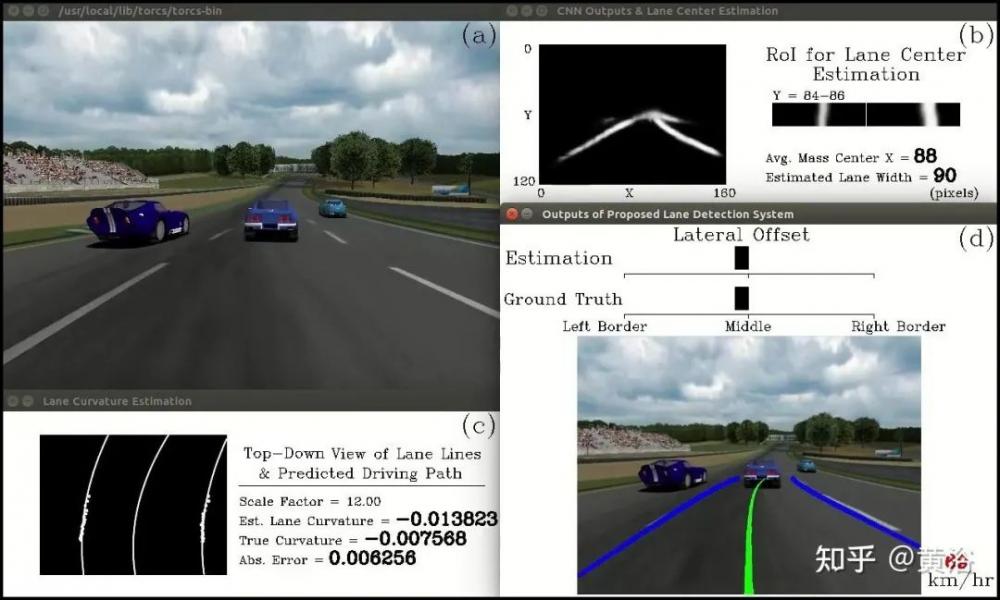

提出three-task convolutional neural network (3TCNN),包括一个bounding box的regression分支、一个Hu moments的regression分支和一个classification分支。其中Hu moments回归能做车道线定位和道路引导。另外,本文特别点是一个lateral offset-path prediction (PP)模块,能够预测驾驶道路,包括车道中心线动态估计和道路曲率估计。

如图是其实现在TORCS的结构:

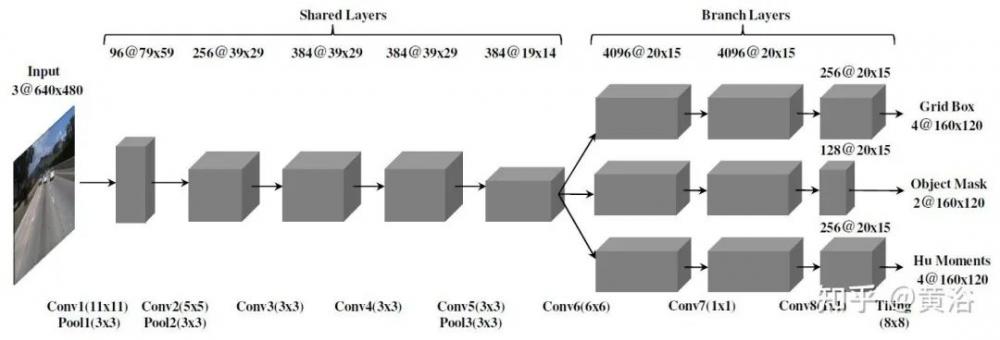

3TCNN的模型架构如下:

实验结果比较3TCNN和2TCNN(没有Hu moments分支)如下:

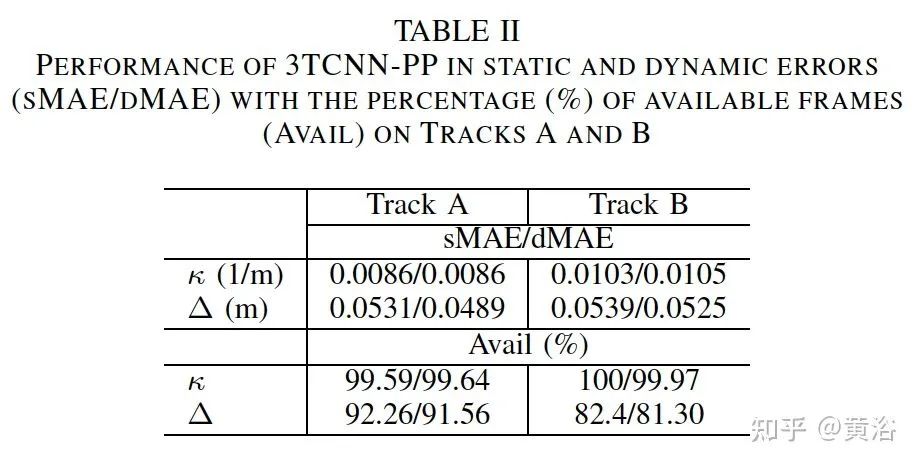

而3TCNN-PP集成的结果在TORCS的模拟环境测试性能如下:

11 “Robust Lane Detection via Expanded Self Attention“,arXiv 2102.07037,2,2021

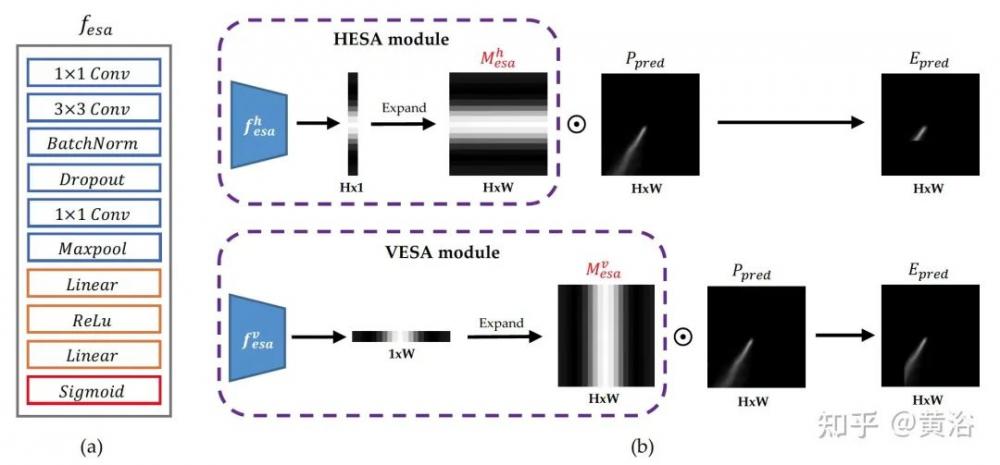

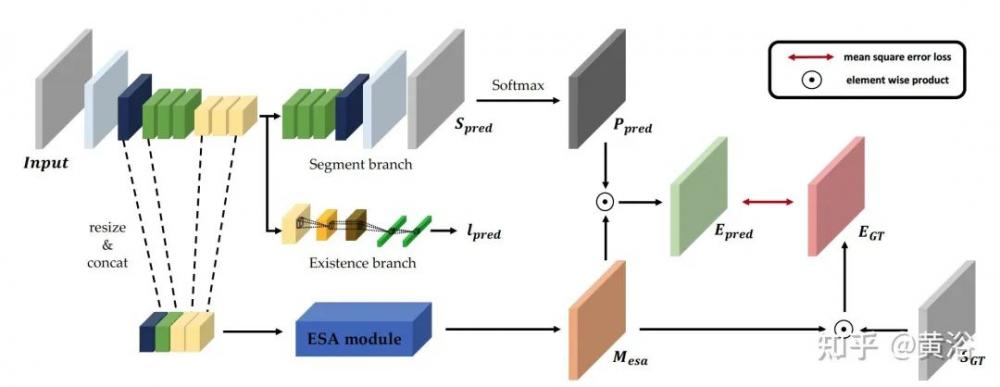

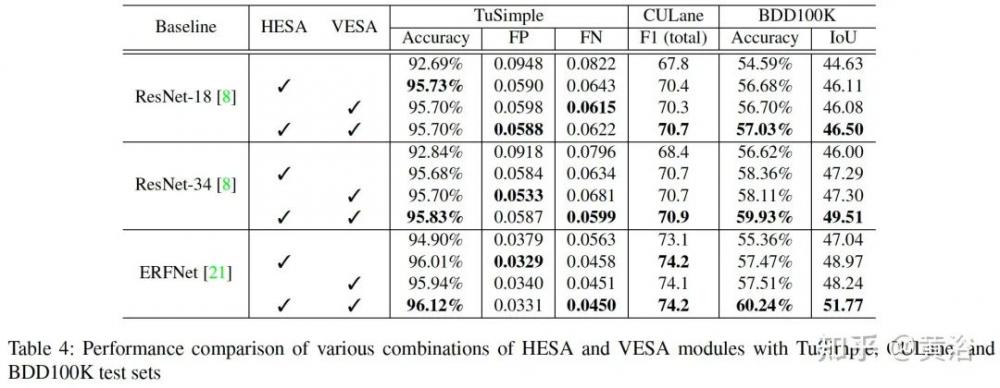

本文是采用self attention机制,可用于编码器-****结构的NN模型,主要就是提取全局信息,在三个基准数据测试TuSimple、CULane和BDD100K。其利用车道线的简单结构,预测车道线在图像沿着水平和垂直方向的可信度,分为HESA (Horizontal Expanded Self Attention) 和 VESA(Vertical Expanded Self Attention)。该方法类似SAD,但提出了基于confidence的遮挡解决方法。

ESA编码器-****的NN模型结构如下:

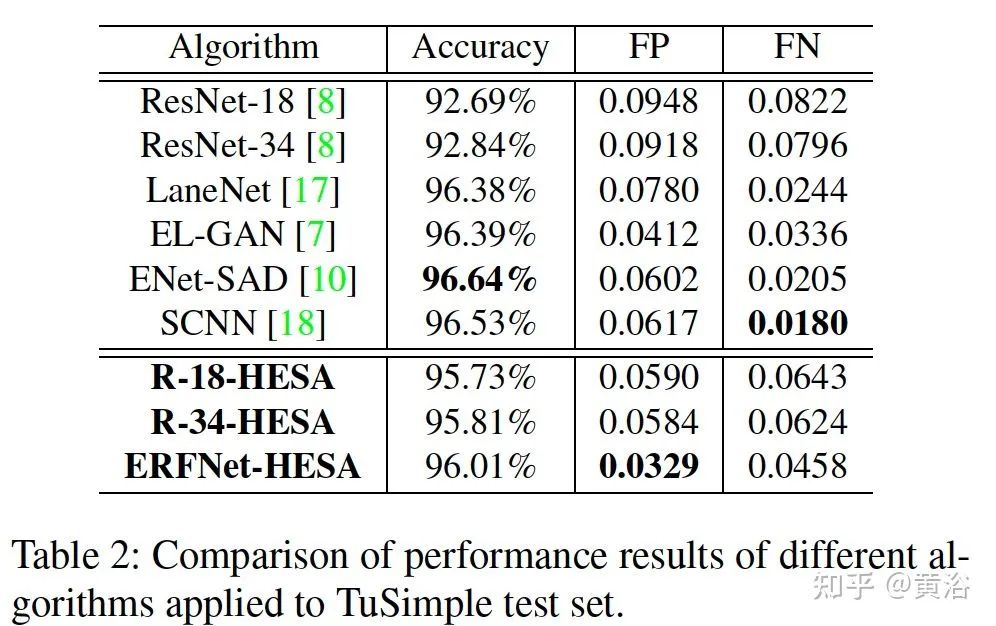

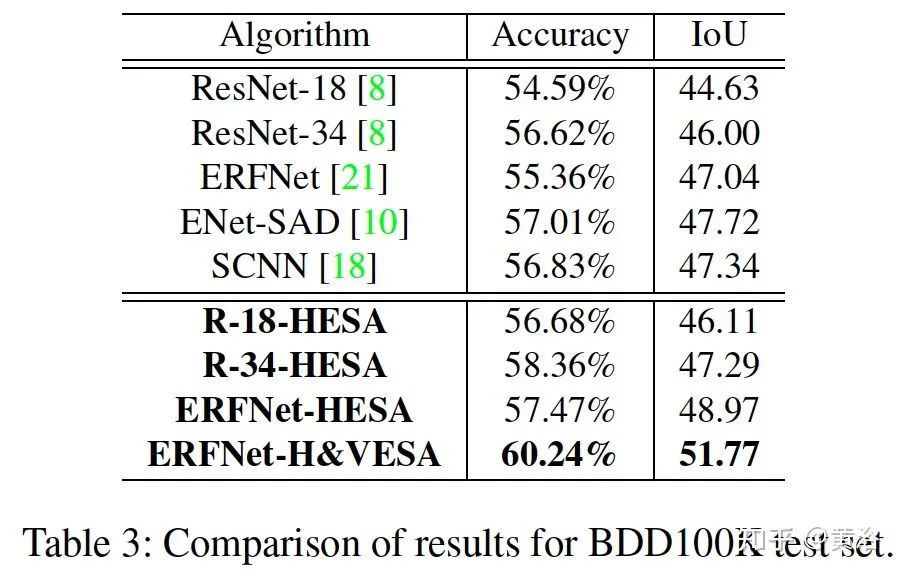

一些实验结果比较如下:三个测试数据集

*博客内容为网友个人发布,仅代表博主个人观点,如有侵权请联系工作人员删除。